YouTube envían videos violentos y gráficos de armas a niños, según un estudio

La plataforma YouTube no logra detener la difusión de videos aterradores que podrían traumatizar a los niños.

WASHINGTON (AP) — Cuando los investigadores de una organización sin fines de lucro que estudia las redes sociales querían comprender la conexión entre los videos de YouTube y la violencia armada, crearon cuentas en la plataforma que imitaban el comportamiento de los niños típicos que viven en EE. UU.

Simularon a dos niños de nueve años a los que les gustaban los videojuegos. Las cuentas eran idénticas, excepto que una hacía clic en los videos recomendados por YouTube y la otra ignoraba las sugerencias de la plataforma.

La cuenta que hizo clic en las sugerencias de YouTube pronto se inundó con videos gráficos sobre tiroteos en escuelas, videos de entrenamiento con armas tácticas e instrucciones sobre cómo hacer que las armas de fuego sean completamente automáticas. Un video mostraba a una niña en edad de escuela primaria empuñando una pistola; otro mostraba a un tirador que usaba una pistola calibre .50 para dispararle a una cabeza ficticia llena de sangre y cerebros realistas. Muchos de los videos violan las propias políticas de YouTube contra el contenido violento o sangriento.Noticias destacadas de AP 16 de mayo AEsto es lo último para el martes 16 de mayo: Biden y los líderes del Congreso realizarán negociaciones sobre la deuda; Tiroteo fatal en Nuevo México; Kiev, Ucrania atacada con misiles; El peligro de inundación cierra partes de Yosemite.

Los hallazgos muestran que, a pesar de las reglas de YouTube y los esfuerzos de moderación del contenido, la plataforma no logra detener la difusión de videos aterradores que podrían traumatizar a los niños vulnerables, o enviarlos por caminos oscuros de extremismo y violencia.

“Los videojuegos son una de las actividades más populares para los niños. Puedes jugar un juego como “Call of Duty” sin terminar en una tienda de armas, pero YouTube los está llevando allí”, dijo Katie Paul, directora de Tech Transparency Project, el grupo de investigación que publicó sus hallazgos sobre YouTube el martes. “No son los videojuegos, no son los niños. Son los algoritmos”.

Las cuentas que siguieron los videos sugeridos de YouTube recibieron 382 videos diferentes relacionados con armas de fuego en un solo mes, o alrededor de 12 por día. Las cuentas que ignoraron las recomendaciones de YouTube aún recibieron algunos videos relacionados con armas, pero solo 34 en total.

Los investigadores también crearon cuentas que imitaban a niños de 14 años; esas cuentas también recibieron niveles similares de contenido relacionado con armas y violencia.

Uno de los videos recomendados para las cuentas se titulaba “Cómo funciona un interruptor en una Glock (solo con fines educativos)”. Más tarde, YouTube eliminó el video después de determinar que violaba sus reglas; un video casi idéntico apareció dos semanas después con un nombre ligeramente alterado; ese video sigue disponible.

Una portavoz de YouTube defendió las protecciones de la plataforma para los niños y señaló que requiere que los usuarios menores de 17 años obtengan el permiso de sus padres antes de usar su sitio; las cuentas para usuarios menores de 13 años están vinculadas a la cuenta de los padres. “Ofrecemos una serie de opciones para los espectadores más jóvenes”, escribió la compañía en un comunicado enviado por correo electrónico. “… Que están diseñados para crear una experiencia más segura para preadolescentes y adolescentes”.

Junto con TikTok, la plataforma para compartir videos es uno de los sitios más populares para niños y adolescentes. Ambos sitios han sido criticados en el pasado por albergar y, en algunos casos, promover videos que fomentan la violencia armada, los trastornos alimentarios y las autolesiones. Los críticos de las redes sociales también han señalado los vínculos entre las redes sociales, la radicalización y la violencia en el mundo real.

Los perpetradores detrás de muchos tiroteos masivos recientes han utilizado las redes sociales y las plataformas de transmisión de video para glorificar la violencia o incluso transmitir en vivo sus ataques. En publicaciones en YouTube , el tirador detrás del ataque en 2018 en una escuela en Parkland, Florida, que mató a 17 personas, escribió “Quiero matar gente”, “Voy a ser un tirador escolar profesional” y “Tengo no hay problema en dispararle a una chica en el pecho”.

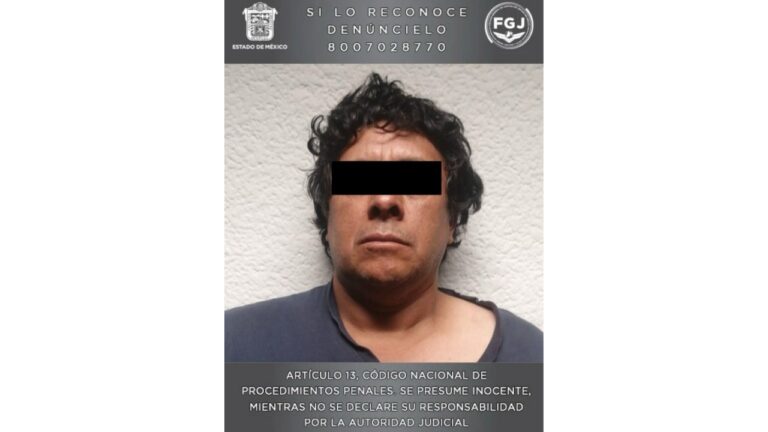

El pistolero neonazi que mató a ocho personas a principios de este mes en un centro comercial del área de Dallas también tenía una cuenta de YouTube que incluía videos sobre cómo armar rifles, la serie que mató a Jeffrey Dahmer y un clip de una escena de un tiroteo en una escuela en un programa de televisión.

En algunos casos, YouTube ya eliminó algunos de los videos identificados por los investigadores del Tech Transparency Project, pero en otros casos el contenido permanece disponible. Muchas grandes empresas de tecnología confían en sistemas automatizados para marcar y eliminar contenido que viola sus reglas, pero Paul dijo que los hallazgos del informe del Proyecto muestran que se necesitan mayores inversiones en moderación de contenido.

En ausencia de una regulación federal, las empresas de redes sociales deben hacer más para hacer cumplir sus propias reglas, dijo Justin Wagner, director de investigaciones de Everytown for Gun Safety, una organización líder en defensa del control de armas . El grupo de Wagner también dijo que el informe del Tech Transparency Project muestra la necesidad de restricciones de edad más estrictas en el contenido relacionado con armas de fuego.

“Los niños que no tienen la edad suficiente para comprar un arma no deberían poder recurrir a YouTube para aprender a construir un arma de fuego, modificarla para que sea más letal o cometer atrocidades”, dijo Wagner en respuesta a Tech Transparency Project. informe.

Se han planteado preocupaciones similares sobre TikTok después de que informes anteriores mostraran que la plataforma estaba recomendando contenido dañino para los adolescentes.

TikTok ha defendido su sitio y sus políticas, que prohíben a los usuarios menores de 13 años. Sus reglas también prohíben videos que fomenten comportamientos dañinos; los usuarios que buscan contenido sobre temas que incluyen trastornos alimentarios reciben automáticamente un aviso que ofrece recursos de salud mental.

KJ

Sorry. No data so far.